Wie kann man zwischen echten und KI-Bildern unterscheiden? Mit der extrem schnell fortschreitenden Entwicklung der KI-Technologie wird diese Frage unser ständiger Begleiter sein (müssen). Wie die Fotowelt mit der zunehmenden Verunsicherung und dem Missvertrauen veröffentlichten Bildern gegenüber umgeht, lesen Sie hier in unserem Bericht*.

Zwischen echten und KI-Bildern unterscheiden

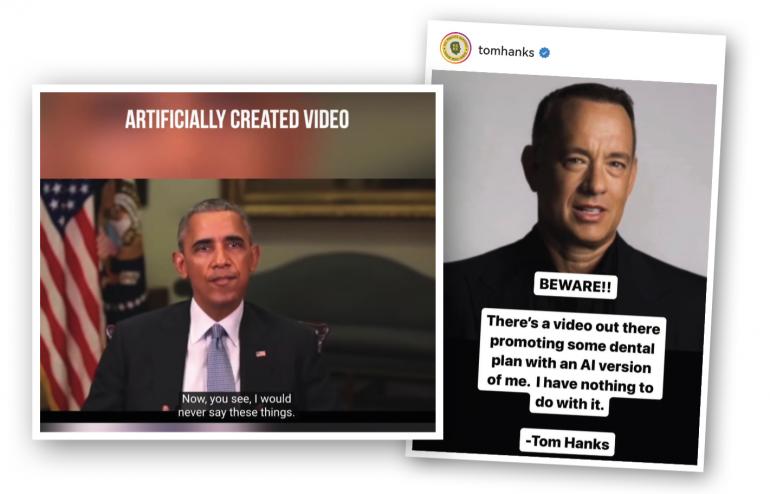

Neben den sogenannten Fake News ist der englische Begriff „Deepfake“ längst auch in unserem Sprachgebrauch angekommen. Deepfakes sind Bild-, Video- oder Audiobeiträge, die computergeneriert worden sind und etwas Unechtes, Gefälschtes darstellen. Die Ziele können unterschiedlich sein.

Im besten Fall sind es friedlich-freundliche Intentionen und die KI-generierten Bilder stellen die Kreativität der Schaffenden dar. Auf der anderen Seite findet man aber pornografische, (politisch) manipulative, hassgeladene Inhalte, die gezielt Lügen verbreiten, verschiedene Gruppen beleidigen, angreifen und gegeneinander aufhetzen, zum Kauf diverser Produkte animieren und Persönlichkeitsrechte verletzen.

Vor allem auch im Hinblick auf Wahlkämpfe, Staatskonflikte und weltgeschichtliche Themen sorgen bewusst eingesetzte Desinformation und Manipulation für große Risiken und können weitreichende Schäden mit sich bringen. Die Liste ist also lang … dennoch sind gefälschte Inhalten in den (Online-)Medien keine aktuelle Erfindung.

Bereits 2017 sind Videos, wie etwa die gefälschte Rede von Barack Obama online erschienen. Dieses war zwar Teil einer für die Gefahren der KI-Generatoren Bewusstseins-fördernden Kampagne, es zeigte aber, wie weit die Technologie bereits damals war und dass die Menschen diese im Blick hätten behalten sollen.

Irreführende Informationen mit gefälschten Kriegsbildern gab es und gibt es leider immer noch. Bei der Berichterstattung über Kampfgeschehnisse ist es auch schon vorgekommen, dass man Menschen und Orte miteinander kombiniert hat, obwohl die Aufnahmen nicht vom beschriebenen Ort stammten.

Auch sind gestellte Situationen nichts Neues auf dem Gebiet der Informationsverbreitung. Und mit Photoshop wurden bereits vor Jahren zum Beispiel aufwendige Composings mit prominenten Gesichtern erstellt, die diese bloß stellen sollten.

Was heutzutage aber noch mehr zum Nachdenken bringt, ist, wie leichtgängig und zugänglich KI-Generatoren sind. Auch absolute Laien in der Bildbearbeitung oder Berichterstattung können sie bedienen. Somit ist die Erstellung gefälschter und desinformierender Bildinhalte für alle möglich – egal ob voll- oder minderjährig, egal an welcher Ecke der Welt lebend und mit welchem Zweck nutzend. Dazu entwickelt sich die Technik rasant weiter.

Durch unsere digitale Vernetzung lassen sich Inhalte heute problemlos in Echtzeit verbreiten, weltweit. Informationen, ob echt oder nicht, erreichen so viele Menschen so schnell wie noch nie.

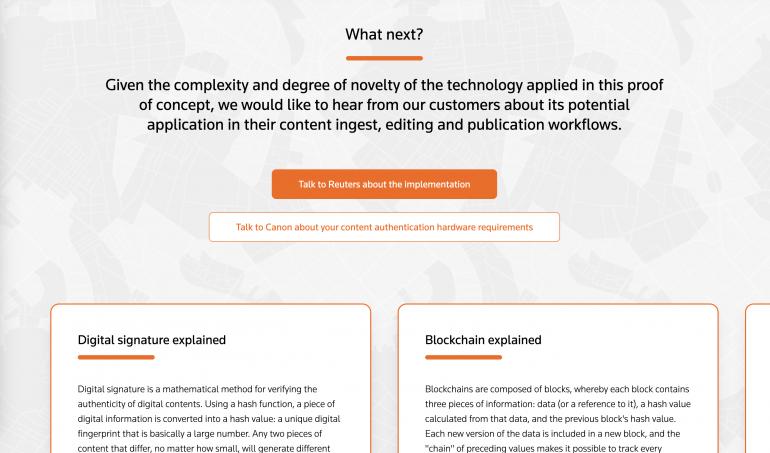

Die „Content Authenticity Initiative“ wurde bereits 2019 ins Leben gerufen und verfolgt das Ziel, das Vertrauen der Öffentlichkeit in digitale Bildinhalte zu bewahren. Die Spezifikationen werden immer wieder verfeinert und nun haben wir schon die ersten Kameras, die mit der Echtheitszertifikat-Technologie ausgestattet sind.

Die Content Authenticity Initiative (CAI) von Adobe, X und der New York Times ist eine branchenweite Kooperation, die darauf hinarbeitet, die Integrität digitaler Medieninhalte zu verbessern. Ihr Hauptziel besteht darin, Tools und Standards bereitzustellen, um die Authentizität und Herkunft digitaler Beiträge, zunächst von Fotojournalistinnen und -journalisten, zu verifizieren.

Durch die Integration von Technologien wie Kryptografie und Blockchain soll die Echtheit dieser Medieninhalte jederzeit überprüft werden können. Adobe und andere Branchenführer wie seit 2022 z. B. die großen Kamerahersteller Nikon, Leica, Canon und Sony arbeiten zusammen, um Transparenz und Vertrauen in digitale Bilder und Videos zu fördern und die Verbreitung von Falschinformationen einzudämmen.

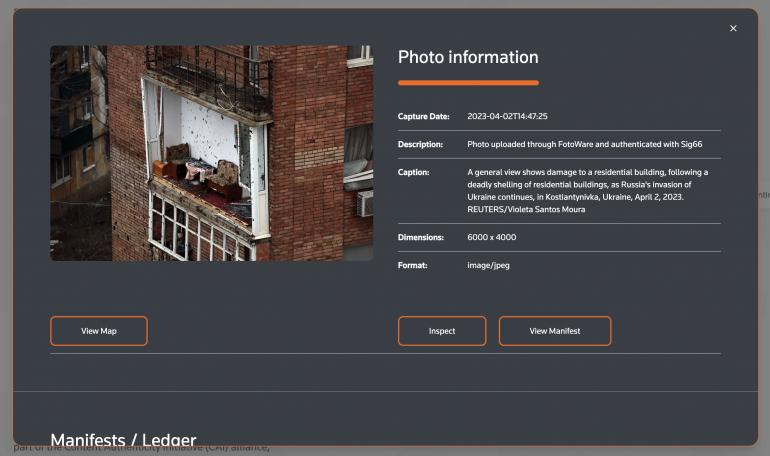

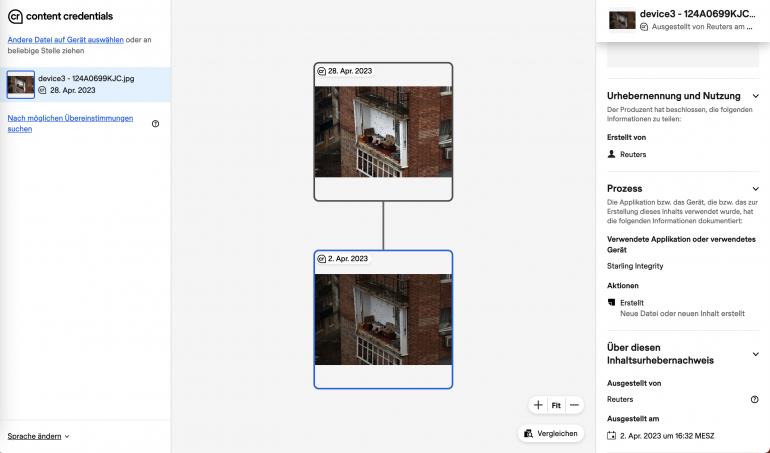

Für diesen Zweck arbeiten die verschiedenen Hersteller an Pilotphasen mit Fotojournalistinnen und -journalisten renommierter Presseagenturen wie Reuters, Associated Press und Agence France-Press und haben diese mit Kameras ausgestattet, die die CAI-Technologie integriert haben. Die aufgenommenen Pressebilder werden digital mit einem eindeutigen Identifikator (Hash-Wert) versehen, der zusätzlich Zeit, Datum und Ort enthält.

Um ihre Echtheit zu belegen, werden sie auch kryptografisch signiert und anschließend in einer öffentlichen Blockchain registriert. Zunächst ist dies auf bestimmte Modelle begrenzt. Zwar werden die gefälschten Bilder dadurch nicht verschwinden, es ist aber ein guter Anfang.

► Auf www.reutersagency.com/authenticity-poc wird anhand von Beispielfotos der Fotografin Violeta Santos Moura, die sie mit einer Canon-Kamera in der Ukraine gemacht hat, veranschaulicht, wie das Überprüfen der implementierten Metadaten und der Blockchain-Registrierung funktioniert.

„Bei unserem Fotowettbewerb setzen wir wie immer einen mehrschichtigen Ansatz ein, um gefälschte oder manipulierte Bilder zu verhindern, unabhängig von der Technologie. In Zusammenarbeit mit externen Forschenden überprüfen wir den beruflichen Status der Fotografierenden und die Fakten hinter ihren Geschichten.

Die Bewertung erfolgt durch Profis, einschließlich Fotoredakteurinnen und -redakteuren, die täglich vertrauenswürdige von nicht-vertrauenswürdigen Bildern unterscheiden müssen. In einem späteren Stadium des Bewertungsprozesses werden Originaldateien angefordert und von zwei unabhängigen digitalen Analysten überprüft.

In den Bearbeitungsrezensionen werden ein Wettbewerbsbeitrag und die originale Datei von der Kamera als separate Ebenen in Adobe Photoshop geladen. Die beiden Bilder werden anschließend neu aneinander ausgerichtet und übereinandergelegt.

Beim Wechsel zwischen den Ebenen werden auch Unterschiede zwischen den beiden Bildern offensichtlich. Eine Reihe weiterer Prozesse wird verwendet, um eine klare visuelle Darstellung von allen Details zu geben, die unterschiedlich sind. Wir arbeiten immer mit Expertinnen und Experten mit einem enormen Wissen in ihrem Bereich.

Da nur die Finalistenbilder geprüft werden, ist es schwer zu sagen, wie viele manipulierte Bilder jährlich eingereicht werden. Fast immer, wenn Einträge aufgrund forensischer Überprüfungen ausgeschlossen werden, ist es wahrscheinlich, dass die fotografierende Person nicht absichtlich täuscht. Meistens liegt es daran, dass es innerhalb der breiteren fotografischen Gemeinschaft unterschiedliche Meinungen darüber gibt, was ethisch vertretbar ist.“

Vertrauen haben, aber wie?

Das Vertrauen in die Berichterstattung und Informationsvermittlung allgemein leidet extrem in der heutigen Zeit. Laut des Digital News Reports 2023 vom Reuters Institute und der University of Oxford, der im Juni 2023, also noch vor dem Gaza-Krieg, erschien, vertrauen nur 43 % der Befragten in Deutschland den Nachrichtenkanälen allgemein und 53 % den Nachrichtenkanälen, die sie sich selbst ausgesucht haben und nutzen. Je jünger die Teilnehmenden, desto kleiner wird die Prozentzahl:

Unter den 18- bis 24-Jährigen sind es 43 % bei den eigenen Nachrichtenkanälen, ab 55 Jahren sind es immerhin 64 %. Die vermehrte Berichterstattung über Fake News verunsichert die Menschen zunehmend in ihrem Konsum von Medieninhalten – sind ältere Generationen doch eigentlich in dem Glauben aufgewachsen, der linearen Berichterstattung in TV und Zeitung vollends vertrauen zu können, während die jungen Leute schon mit so vielen Deepfakes konfrontiert worden sind, dass sie Inhalte sowieso nur schwer als glaubwürdig halten können.

Dies bestätigt auch Anna Lena Mehr, World Press Photo Contest Director: „Ich denke, das große Problem betrifft das Vertrauen im Allgemeinen. Szenen können inszeniert werden, die Rahmengebung von Bildern kann täuschend sein, die Fotomanipulation existiert fast so lange wie die Fotografie selbst, und digitale Bearbeitungssoftware gibt es seit Jahrzehnten.

Unser Wettbewerb liegt außerhalb des 24/7-Medienzyklus und wir müssen nicht mit der Geschwindigkeit von Social Media arbeiten. Wir können uns Zeit nehmen, um jedes Finalistenbild sorgfältig zu überprüfen. Die Frage ist, wie Menschen weiterhin Vertrauen in die Presse- und Dokumentarfotografie im Allgemeinen haben können.“

Aber auch umgekehrt – Fotos, die echt sind, können Zielscheibe manipulativer Angriffe werden, wie uns Andrew Davies, Communications/Marketing Director der World Press Photo Foundation berichtet: „Es gab einen enormen Aufstand, unser Foto des Jahres 2023 (s. weiter oben) zu diskreditieren. Es wurde behauptet, es sei gefälscht oder inszeniert worden.

Das war es aber nicht – es gibt Videobeweise und mehrere gründliche Untersuchungen des Vorfalls, darunter eine von der Organisation für Sicherheit und Zusammenarbeit in Europa. Der Zweck dieser Anschuldigungen bestand eher darin, das Vertrauen in das Foto zu schwächen und die Verwirrung zu erhöhen. Es wird immer häufiger vorkommen, dass Menschen, die ein bestimmtes Bild nicht mögen, es als gefälscht bezeichnen.“

„Wir nehmen Fotojournalismus sehr ernst und begegnen der Echtheit von Fotografie natürlich schon lange mit gesundem Misstrauen. Die Prüfung auf KI-generierte Bilder ist einer von mehreren Parametern beim Ausschluss möglicher Manipulationen.

In unseren Bildeingang laufen täglich über 20.000 Fotos aus ganz unterschiedlichen Quellen ein. Bei der Bebilderung von Themen nutzen wir diese unterschiedlichen Quellen, um Fotos relevanter Ereignisse zu vergleichen.

Natürlich prüfen wir in der Bildredaktion der F.A.Z. auch die Dateiinformationen und Metadaten von Bildern; vor allem verlassen wir uns aber auf vertraute Fotojournalistinnen und -journalisten und professionelle Nachrichtenagenturen, mit denen wir im engen Austausch sind.

Auch aus diesem Grund haben wir zwei festangestellte Redaktionsfotografen und arbeiten gerne langfristig mit freiberuflichen Fotografinnen und Fotografen in Deutschland und der Welt zusammen.“

Um Manipulationen und Fälschungen aufzudecken und die Authentizität eines Mediums zu bestätigen, werden häufig forensische Untersuchungen eingesetzt. Aufgrund der wachsenden Zahl an KI-generierten Bildbeiträgen werden diese besonders gefragt sein.

Forensische Bildanalyse behandelt die Untersuchung von Bildern oder visuellen Medien im Rahmen forensischer Untersuchungen. Dies kann die Authentizität von Bildern überprüfen, digitale Manipulationen aufdecken, Bilder analysieren, um Beweise für kriminelle Handlungen zu finden, oder Personen und Objekte auf Bildern identifizieren.

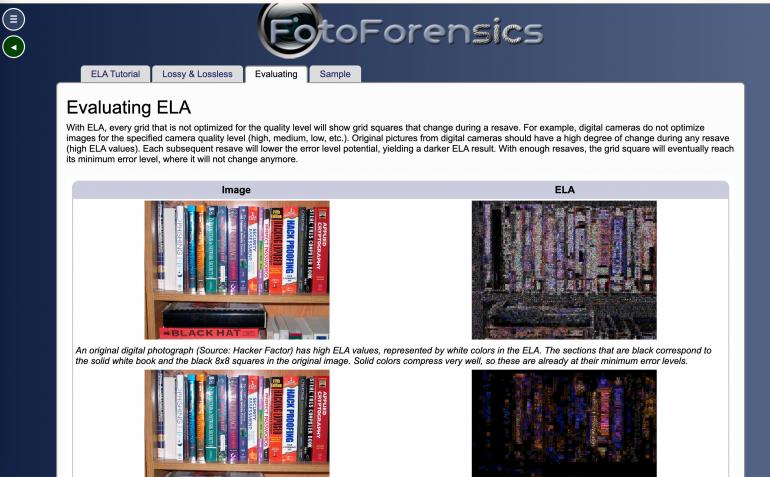

Es umfasst Techniken wie Bildvergrößerung, Licht-Schatten-Analyse, Vergleichsanalysen und die Nutzung spezialisierter Software, um Details zu extrahieren oder Veränderungen zu erkennen. Auf Websites wie https://fotoforensics.com (s. Screenshot) oder https://29a.ch/photo-forensics (Forensically) können Sie auch selbst Bilder untersuchen lassen.

Dort finden Sie gute Beispiele mit ausführlichen, verständlichen Erklärungen (allerdings auf Englisch) der angewendeten Untersuchungsmethoden. Dabei ist es wichtig zu betonen, dass solche Online-Angebote nicht die tiefgründige Bildanalyse einer in diesem Bereich ausgebildeten Person mit Arbeitserfahrung (Forensikerin bzw. Forensiker) und eine leistungsstarke Spezialsoftware ersetzen können.

Und was machen wir nun?

Die KI-Generatoren zur Bild- und Videoerstellung sind da und werden bleiben. Sie ermöglichen uns, sich kreativ auszutoben, Neues zu kreieren – für private und berufliche Zwecke. Nur was tun wir gegen gefälschte und menschenunwürdige Inhalte? Wie schützen wir uns vor Manipulation und Desinformation?

Wichtig ist es, Menschen immer wieder aufzuklären, für die Folgen ihrer Handlungen zu sensibilisieren, für die kreativen Seiten zu begeistern – schon im jungen Alter. Wenn es um Nachrichten geht, sollte man die Quellen und Inhalte hinterfragen – gibt es andere Portale, die die angezeigten Informationen präsentieren und bestätigen, vor allem renommierte Medien und Nachrichtenagenturen? Wer verbreitet eine Meldung?

Gibt es Details im Beitrag, die nicht korrekt dargestellt werden etc.? Nicht zuletzt ist es sehr wichtig, dass KI-generierte Beiträge als solche markiert werden. Im Juni 2023 sind Konzerne wie Google, Microsoft & Co. von der EU-Kommission dazu verpflichtet worden, KI-Inhalte in ihren Suchmaschinen zu kennzeichnen. Seit Februar 2024 auch Meta – die auf ihre Plattformen hochgeladenen Bilder werden von der eigenen KI analysiert und die KI-generierten markiert.

*Stand der Recherche: 6. Februar 2024